what-is-kling-ai.md 11 KB

+++ title = "可靈大模型Kling AI是什麼?" date = "2024-07-29T00:39:46+02:00" tags = ["ai"] categories = ["ai"] banner = "https://framerusercontent.com/images/cAvZ3L9uzIUAmtJfIVPQUQXe7o.jpg" +++

可靈大模型Kling AI 是由快手模型團隊開發的視頻生成模型,具有強大的視頻生成能力,允許用戶輕鬆高效地完成藝術視頻創作。

快手是TikTok 在中國的兄弟抖音的主要競爭對手之一,上週在上海舉行的世界人工智慧大會(WAIC) 上展示了其文字轉視頻模型Kling AI 的多項新功能,包括生成最多10 個影片的能力秒。

在 WAIC,參觀者排隊等待體驗類似 Sora 的工具,該工具目前僅透過邀請才能使用。用戶發送簡單的提示來生成視頻,例如“熊貓吃鮭魚”和“蒙娜麗莎用手戴上眼鏡”,生成的剪輯展示了 Kling AI 近乎完美地渲染輸入的能力。

人工智慧生成的影片隨後充斥著中國互聯網,Kling AI 被用來製作歷史電影中的人物執行現代任務的剪輯,並催生了多個表情包。

近日,一段《還珠格格》中的人物容嬤嬤給紫微公主餵雞腿的影片在社群平台上瘋傳。這段人工智慧生成的影片取材自該劇最著名的場景,即容嬤嬤用針反覆刺傷紫薇,以折磨她。

AI生成的影片截圖顯示,榮嬤嬤正在餵紫微公主吃雞腿。信用:互聯網

重要性:快手希望其自主開發的大型模型系列,包括語言模型KwaiYii、以圖像為中心的Kolors 和以視頻為中心的Kling 等,能夠在繼續挑戰字節跳動的抖音和TikTok 的過程中為其帶來優勢。

詳情:快手高級副總裁蓋坤上週末在WAIC論壇上透露,已有超過50萬用戶申請幫助Kling內測,目前生成的影片數量已達700萬條。 Sora 競爭對手的炒作如此之大,以至於可以在 X(以前稱為 Twitter)上找到教中國境外用戶如何申請 Kling AI 試驗的英文貼文。

- 快手在WAIC活動的螢幕上提供了實用的提示,包括建議使用者使用簡單的單字和句子結構,避免過於複雜的語言。它還強調,它的模型對數字不敏感,舉了一個例子,如果提示是“海灘上的 10 隻小狗”,則該數字可能不會在其輸出中始終保持不變。

- 快手大型語言模型團隊的一位工作人員告訴動點科技,他們不方便透露用於訓練Kling AI的數據,但表示它是開源的。

- 同時,TikTok 的競爭對手在 WAIC 上宣布,其類似 Midjourney 的模型 Kolors 將開源,快手錶示此舉旨在為文本到圖像生成社區建立一個更加繁榮的生態系統。

- 快手的研發投入四年來翻了兩番,支出從2019年的29億元增加到2023年的123億元。

背景:中國第二大短視頻公司快手首席執行官程一笑表示,快手於2023年啟動了人工智慧策略,他表示,生成式人工智慧對於內容平台來說具有「非常豐富的業務場景組合和巨大的價值潛力」。

什麼是克林人工智慧?

Kling 是由快手開發的尖端人工智慧視訊生成器,快手是一家與 TikTok 競爭的北京公司。 Kling 允許用戶創建長達 10 秒、每秒 30 幀、1080P 解析度和靈活寬高比的影片。

創作者聲稱他們的人工智慧模型在理解物理和準確建模複雜運動方面表現出色。

就上下文而言,Sora 需要八個 NVIDIA A100 圖形處理單元 (GPU) 運行三個多小時才能產生一分鐘的剪輯。每台 NVIDIA A100 的價格超過 10,000 美元。

如何產生視頻

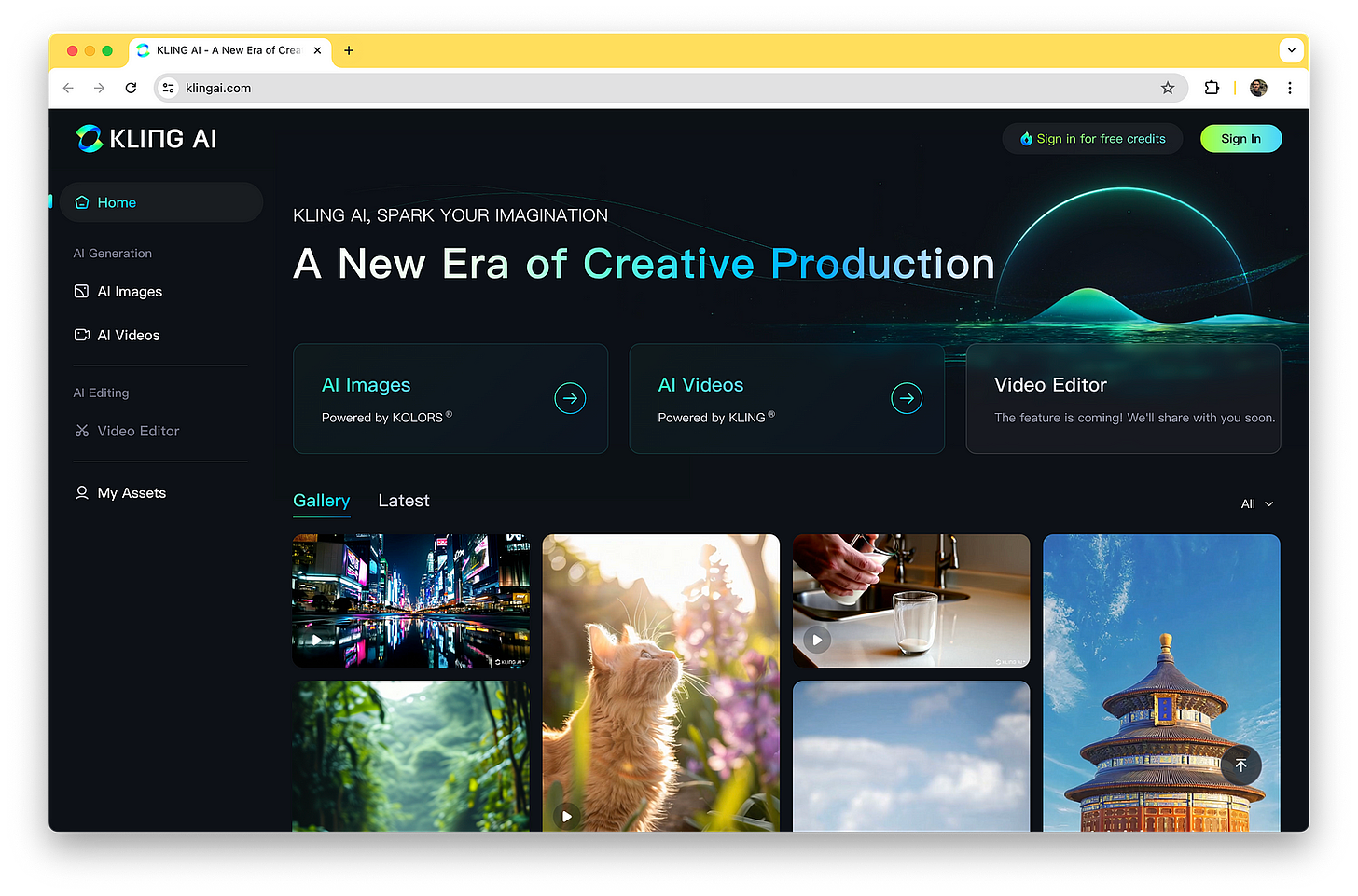

要開始使用 Kling AI,請訪問網站並建立帳戶。進入後,點擊“AI 視訊”選項卡。

吉姆·克萊德·蒙日攝[](https://medium.com/u/819323b399ac)

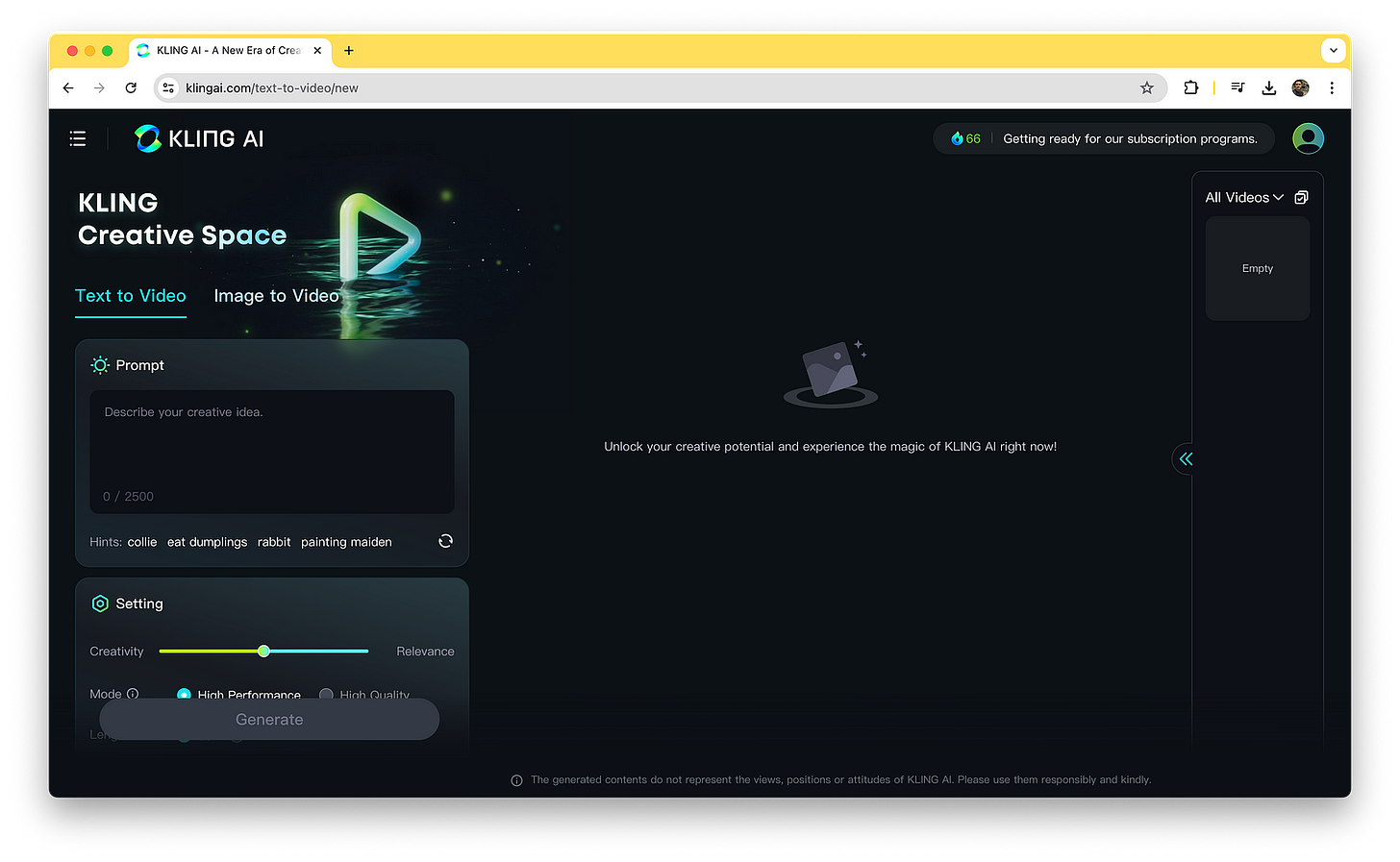

您將被重定向到 Kling 創意空間,在這裡您可以描述您想要創建的影片。

吉姆·克萊德·蒙日攝[](https://medium.com/u/819323b399ac)

這是一個例子:

提示:一名中國男子坐在桌旁,用筷子吃麵條

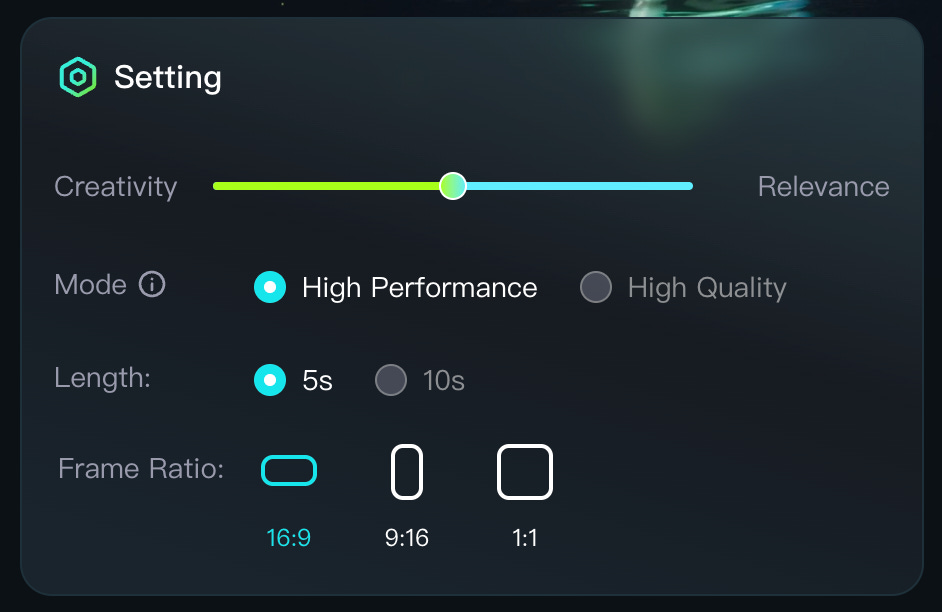

在設定部分,您可以調整創意等級、模式、長度和畫面比例。

吉姆·克萊德·蒙日攝[](https://medium.com/u/819323b399ac)

今天,一種強大的新型視訊生成人工智慧模型已廣泛使用,但有一個問題:該模型似乎正在審查其原產國中國政府認為政治過於敏感的話題。

該模型由總部位於北京的快手公司開發,於今年稍早針對擁有中國電話號碼的用戶推出了候補訪問。今天,它向任何願意提供電子郵件的人推出。註冊後,使用者可以輸入提示,讓模型產生他們所描述內容的五秒影片。

Kling 的工作原理與廣告中的差不多。它的 720p 影片需要一兩分鐘才能生成,不會與提示偏離太遠。 Kling 似乎可以模擬物理現象,例如樹葉的沙沙聲和流水的聲音,以及視訊生成模型,例如 AI 新創公司 Runway 的 Gen-3 和 OpenAI 的 Sora。

但克林絕對_不會_產生有關某些主題的剪輯。像「中國民主」、「中國國家主席習近平走在街上」和「天安門廣場抗議」這樣的提示會產生非具體的錯誤訊息。

圖片來源:快手

過濾似乎僅在提示層級發生。 Kling 支援動畫靜態圖像,例如,只要隨附的提示不提及習近平的名字(例如,「這個人正在發表演講」),它就會毫無怨言地生成習近平的肖像影片。

我們已聯繫快手徵求意見。

圖片來源:快手

克林的奇怪行為很可能是中國政府對該地區的生成型人工智慧計畫施加巨大政治壓力的結果。

讓您的數據為人工智慧時代做好準備\ 參加 8 月 20 日與 Hasura 合作的免費即時網路研討會。

針對當今的人工智慧優化您的資料基礎架構。 | 8 月 20 日在線

Techcrunch 活動

針對當今的人工智慧優化您的資料基礎架構。\ 參加 8 月 20 日與 Hasura 合作的免費現場網路研討會。

針對當今的人工智慧優化您的資料基礎架構。 | 8 月 20 日在線

本月早些時候,英國《金融時報》報道稱,中國的人工智慧模型將接受中國主要互聯網監管機構中國國家互聯網資訊辦公室(CAC)的測試,以確保其對敏感話題的回應「體現社會主義核心價值觀」。根據《金融時報》報道,中信辦官員將根據他們對各種問題的回答對模型進行基準測試——其中許多問題與習近平和對共產黨的批評有關。

據報道,CAC 甚至提出了一份不能用於訓練人工智慧模型的來源黑名單。提交模型供審查的公司必須準備數以萬計的問題,旨在測試模型是否產生「安全」答案。

結果是人工智慧系統拒絕對可能引起中國監管機構憤怒的話題做出回應。去年,英國廣播公司 (BBC)發現,中國公司百度的旗艦人工智慧聊天機器人模型厄尼 (Ernie) 在被問及可能被視為具有政治爭議性的問題(例如“新疆是個好地方嗎?” )時表示異議並轉移話題。或“西藏是個好地方嗎?”

這些嚴厲的政策可能會減緩中國人工智慧的進步。它們不僅需要搜尋資料以刪除政治敏感訊息,而且還需要投入大量的開發時間來創建意識形態護欄——正如克林所舉例,這些護欄可能仍然會失敗。

從使用者的角度來看,中國的人工智慧法規已經催生了兩類模型:有些模型受到了密集過濾的阻礙,而有些則明顯不那麼嚴重。對於更廣泛的人工智慧生態系統來說,這真的是一件好事嗎?